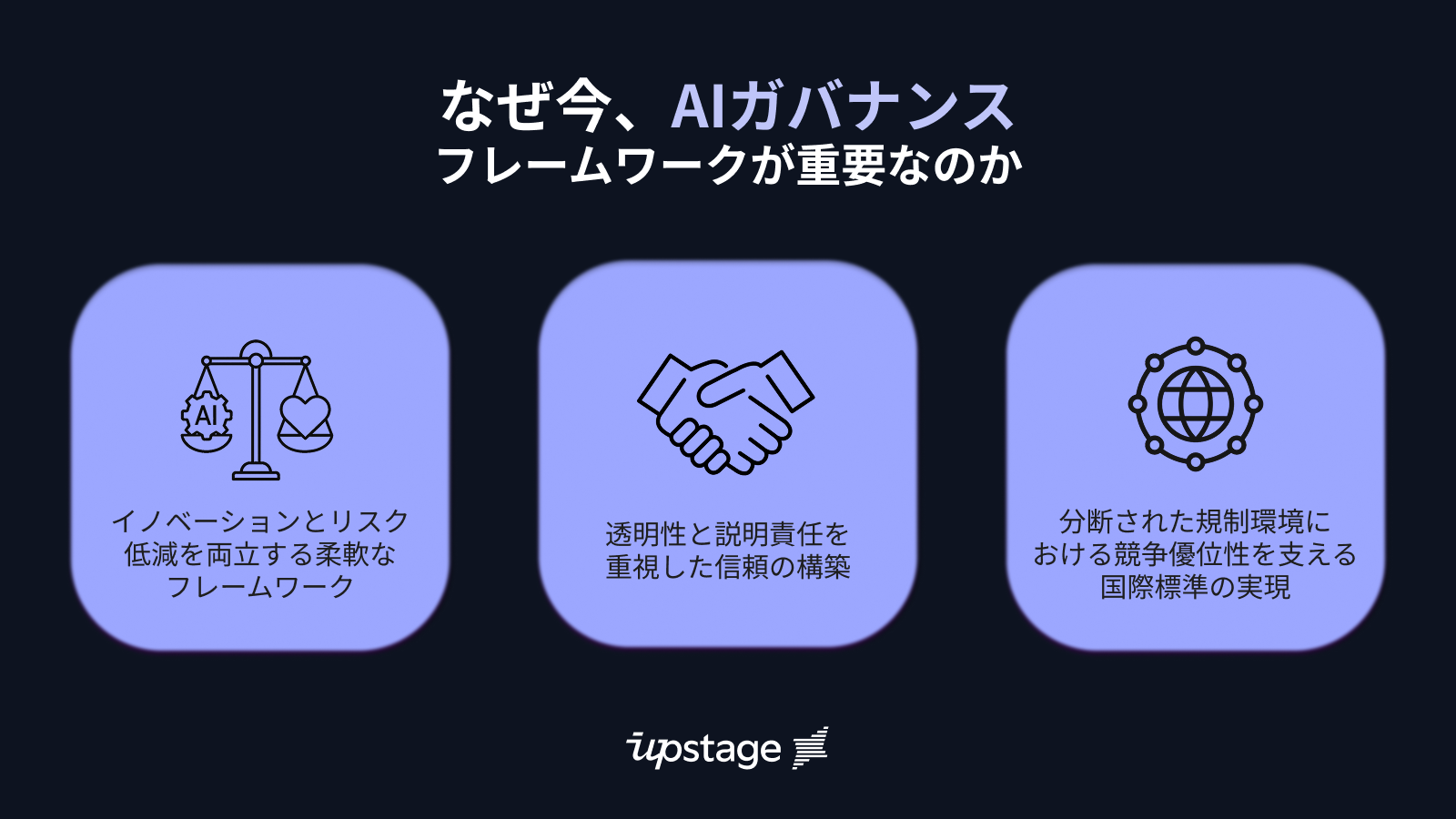

なぜ今、AIガバナンスフレームワークが重要なのか

AIの急速な進化は、経済競争力、行政運営、さらには国家安全保障のあり方にまで大きな影響を及ぼし始めています。AI システムがより高度になり自律性を高めるにつれて、バイアス、誤情報、プライバシー、悪用といった懸念も顕著化し始め、AI導入の意思決定に影響を与えています。

このような状況において、多くの政府は厳格な規制から、イノベーションとリスク軽減の両立を目指すフレームワーク型のガバナンスモデルへと舵を切りつつあります。これらは任意の標準や報告の枠組み、制度間の連携といった、いわゆるソフトロー手法を活用しながら、技術の進化に応じて柔軟に運用できる共通の期待値を示します。ガバナンスフレームワークは、政府・産業界・学術界の間で期待値をすり合わせる調整機能を果たしており、統一的な規制が存在しない環境においても、不確実性を低減する役割を担っているのです。

効果的なAIガバナンスフレームワークは、一般的に次の4つの目標を掲げています。

- イノベーションの促進:システム設計の自由度を過度に制限することなく、技術的な進歩を後押しする

- リスクの軽減:継続的な評価を通じて、安全性、セキュリティ、倫理的なリスクに対応する

- 信頼の構築:透明性と説明責任を確保し、利用者や関係者からの信頼を強化する

- 国際的な整合性:分断された規制環境の中でも、国や地域を超えた相互運用性を実現する

この変化の背景に、AIリスクを社会技術的な問題として捉える視点があります。つまり、リスクはモデルの能力だけでなく、導入の文脈や組織の運用、制度上のインセンティブからも生じる、という認識です。

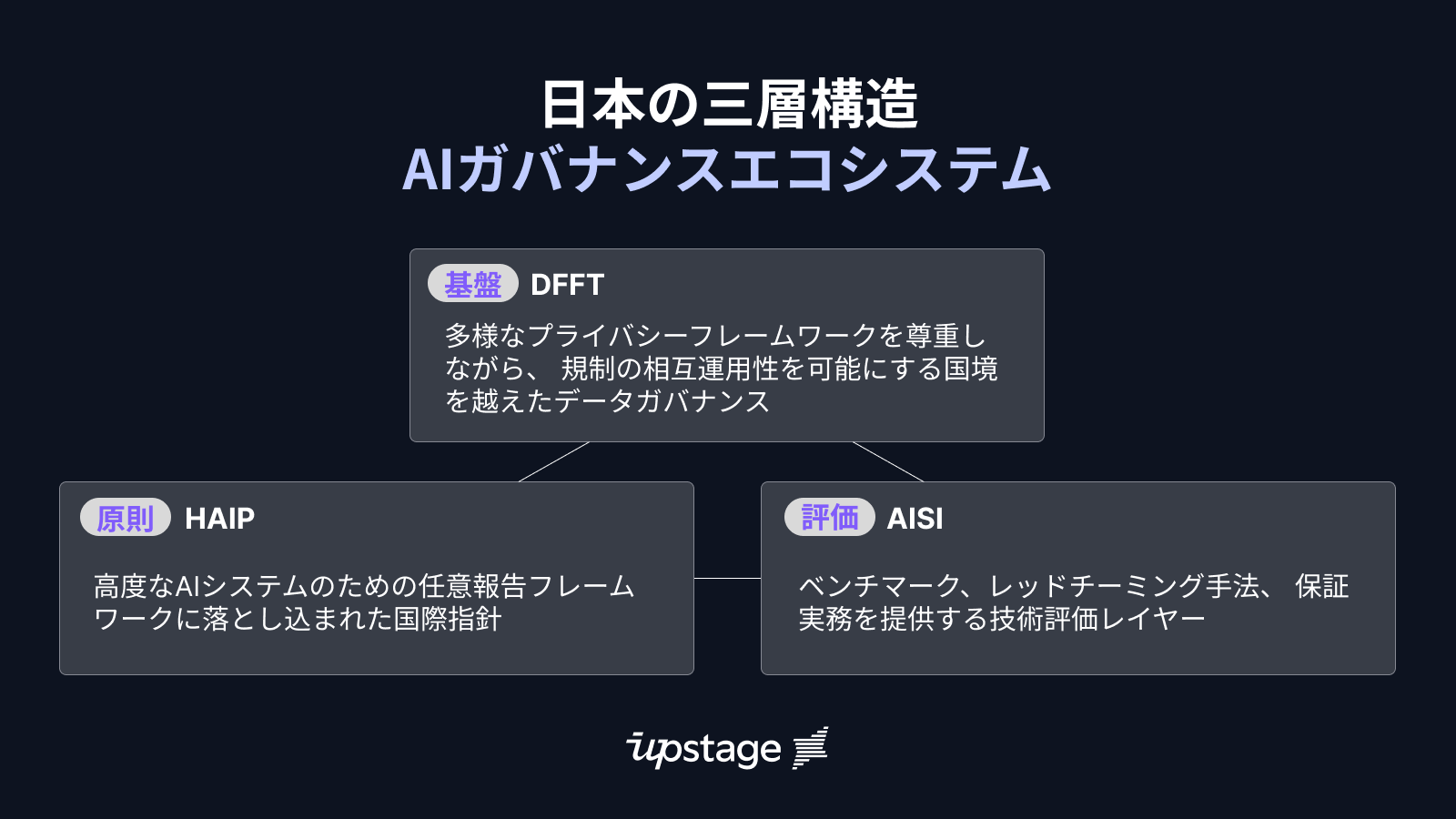

日本のアプローチは、こうした調整を実際にどのように具体化できるかを示す好例です。日本は単一の制度や規制に頼るのではなく、「信頼性のある自由なデータ流通(DFFT)」、「広島AIプロセス(HAIP)」、「AIセーフティ・インスティテュート(AISI)」という複数のフレームワークや機関からなる重層的なエコシステムを構築しています。それぞれが異なるガバナンスのレイヤーを担い、原則を実践へと落とし込む役割を果たしています。

階層的なガバナンスエコシステム

信頼性のある自由なデータ流通(DFFT)

目的と適用範囲:信頼性のある自由なデータ流通(DFFT: Data Free Flow with Trust)は、2019年のG20大阪サミットで日本が提唱した概念です。DFTTは、プライバシーやデータ保護に関する規制が各国で異なる中で、国境を越えて活用できる環境を整えることを目的としています。

- 核となる考え方:DFTTは、無制限なデータ移動や完全な法制度の統一を目指すものではありません。各国のプライバシー、セキュリティ、説明責任に関する要件を尊重しながら、セーフガードを備えた規制の相互運用性を促進することを目指しています。

- 運用メカニズム:実務では、相互認証の枠組み、契約上の取り決め、透明性確保のためのメカニズムなどが活用されています。単一の基準を強制することなく、異なるデータ保護制度同士が協調して機能することを可能にします。

- 企業と公共部門における関連性:複数の市場で事業を展開する組織にとって、DFTTはコンプライアンス要件というよりも、ガバナンス設計の指針として機能します。法務、技術、コンプライアンスの各チームが、規制産業や公共分野においてのAI 導入をサポートしつつ、信頼性を維持する国境を越えたデータアーキテクチャを設計する際の参考となるのです。

広島AIプロセス(HAIP)

広島AIプロセス(HAIP)は、2023年の日本のG7議長国を務めた際にに立ち上げられ、高度なAIシステムに関連するガバナンス課題に対応しています。その成果物である「国際指針原則」と「国際行動規範」は、具体的な技術要件を避けながら、共通の期待値を示しています。

これらの原則を実践に落とし込むために、OECDは2025年初頭にHAIP報告枠組みを導入しました。この報告枠組みは、任意質問票形式の枠組みで、組織がAIの開発・導入プロセス全体を通じて、HAIPの原則をどのように運用しているかを説明するものです。

主な実践項目は次のとおりです:

- 導入文脈を踏まえたリスク評価:組織は、モデル単体の性能だけでリスクを判断するのではなく、特定のユースケースから生じる社会技術的リスクを評価することが求められます。

- インシデント対応と導入後の対処:脆弱性の開示、修正、外部報告のプロセスが含まれます。

- 透明性の確保と文書化:システムの能力や限界、適切な使用方法に関する分かりやすい情報を、政策立案や調達を担う関係者、制度的な利用主体が理解と判断できる形で提供します。

HAIPの大きな特徴は、その反復的な設計にあります。OECDは報告サイクルからのフィードバックを集約し、ガイダンスを段階的に洗練させていきます。固定された基準を設けるのではなく、ベンチマークとピアラーニングを通じて進化する点が特徴です。

AIセーフティ・インスティテュート(AISI)

日本のAISIは、このガバナンスエコシステムにおける技術評価のレイヤーを担います。国際的なAI安全研究所ネットワークの一部として、国内の規制環境や言語的文脈に合わせた評価手法やベンチマーク、信頼性を担保するための評価・保証の実務の整備に注力しています。

AISIの主な取り組みは次のとおりです:

- レッドチーミング手法:「AI セーフティに関する レッドチーミング手法ガイド」は、導入前の検証から実運用環境に至るまで、脆弱性を洗い出すための体系的な手法を示しています。

- 評価の観点:「AI セーフティに関する評価観点ガイド」は、有害な出力の制御や誤情報防止、公平性と包摂性の確保、高リスクなユースケースの取り扱い、プライバシー保護、セキュリティ、説明可能性、堅牢性、データ品質、検証可能性といった対面的な評価項目が整理されています。

- 国際協力とフレームワークの相互運用性:AISIは、国際的なAI安全フレームワークを日本の文脈に落とし込む役割を担うハブとして機能しています。米国のNIST AIリスク管理フレームワークとのクロスウォーク作業などを通じて、海外の事業者が国内基準との整合性を確認できるよう、相互運用性の枠組みを提供しています。

AISIの影響力は、公共調達において最も顕著に表れています。日本政府との契約を目指すベンダーには、AISI基準への整合性を示すことが求められ、ベンチマーク結果や、技術文書、品質保証プロセスに関するエビデンスの提出が一般的です。この環境では、説明可能性は差別化要因ではなく参加の前提要件要件として扱われており、信頼できる文書を備えていない企業は検討対象から外れる可能性もあります。

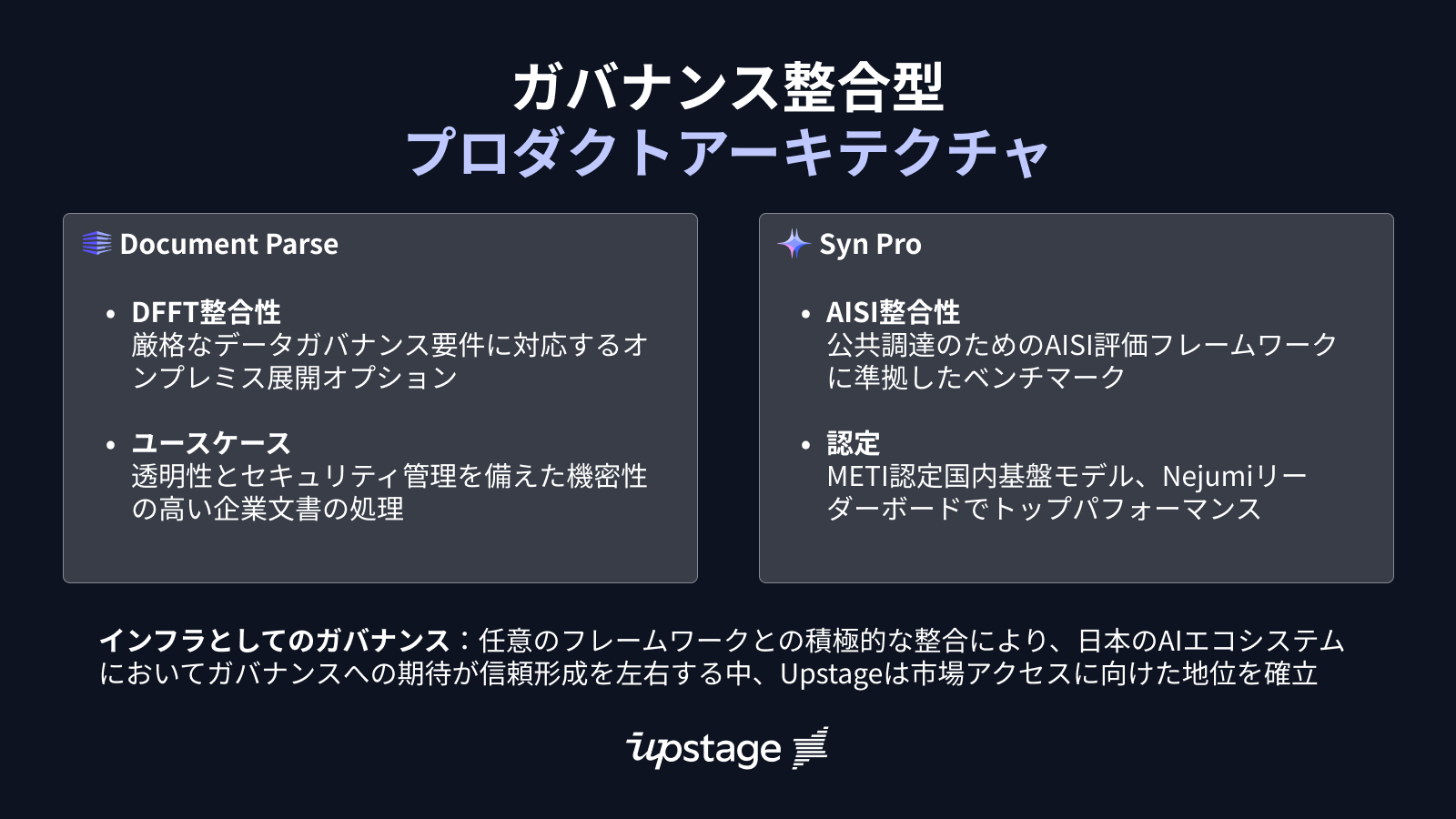

Upstageの視点:ガバナンスを前提とした開発

日本の企業市場および公共部門市場で事業を展開する企業にとって、これまでに紹介してきたフレームワークは、調達時の期待値や、リスク評価の基準、AIプロバイダーと機関利用者との間の信頼関係を形づくる要素となっています。ガバナンスへの整合性は、導入後に求められるコンプライアンス対応ではなく、設計段階から織り込む前提条件になりつつあるのです。

Upstageでは、こうした認識を製品アーキテクチャと文書化戦略に反映しています。

Document Parseとデータガバナンスへの適合:Document Parseは、契約書、財務記録、社内報告書といった機密性の高い企業資料を扱います。DFFTの考え方が、特に透明性、セキュリティ、導入の柔軟性といった観点において、当社のデータ取り扱いに関する意思決定の指針となっています。厳格なデータガバナンス要件を持つ組織向けに、オンプレミス環境や管理された実行環境での導入を可能にする構成は、日本の公共セクターや規制対象業種の期待を踏まえたものです。

Syn Proとモデル評価への対応:カラクリ社と共同開発したSyn Proは、2025年11月に経済産業省の国内基盤モデルリストで認定を受け、Nejumiリーダーボードにおいて32Bパラメータ未満の国内モデルの中で高い性能を示しています。しかし重視しているのは性能だけではありません。公共調達や機関による審査において重要性が高まりつつあることから、AIセーフティ・インスティテュート(AISI)ネットワークが参照するベンチマークや評価手法との整合性を、重要な前提として位置づけています。

こうした取り組みは、AIガバナンスを制約ではなく、インフラとして捉えるUpstageの視点を反映しています。DFFT、HAIP、AISIといった枠組みは、AIシステムが実際の導入においてどのように評価され、信頼を獲得するか左右します。これらのフレームワークがまだ任意である段階から積極的に関与することで、ガバナンスへの期待が市場アクセスや信頼の形成に影響を及ぼす中、日本における責任あるAI導入を支援する立場を確立できると考えています。

.png)

.png)